Novos vetores de ataque de IA

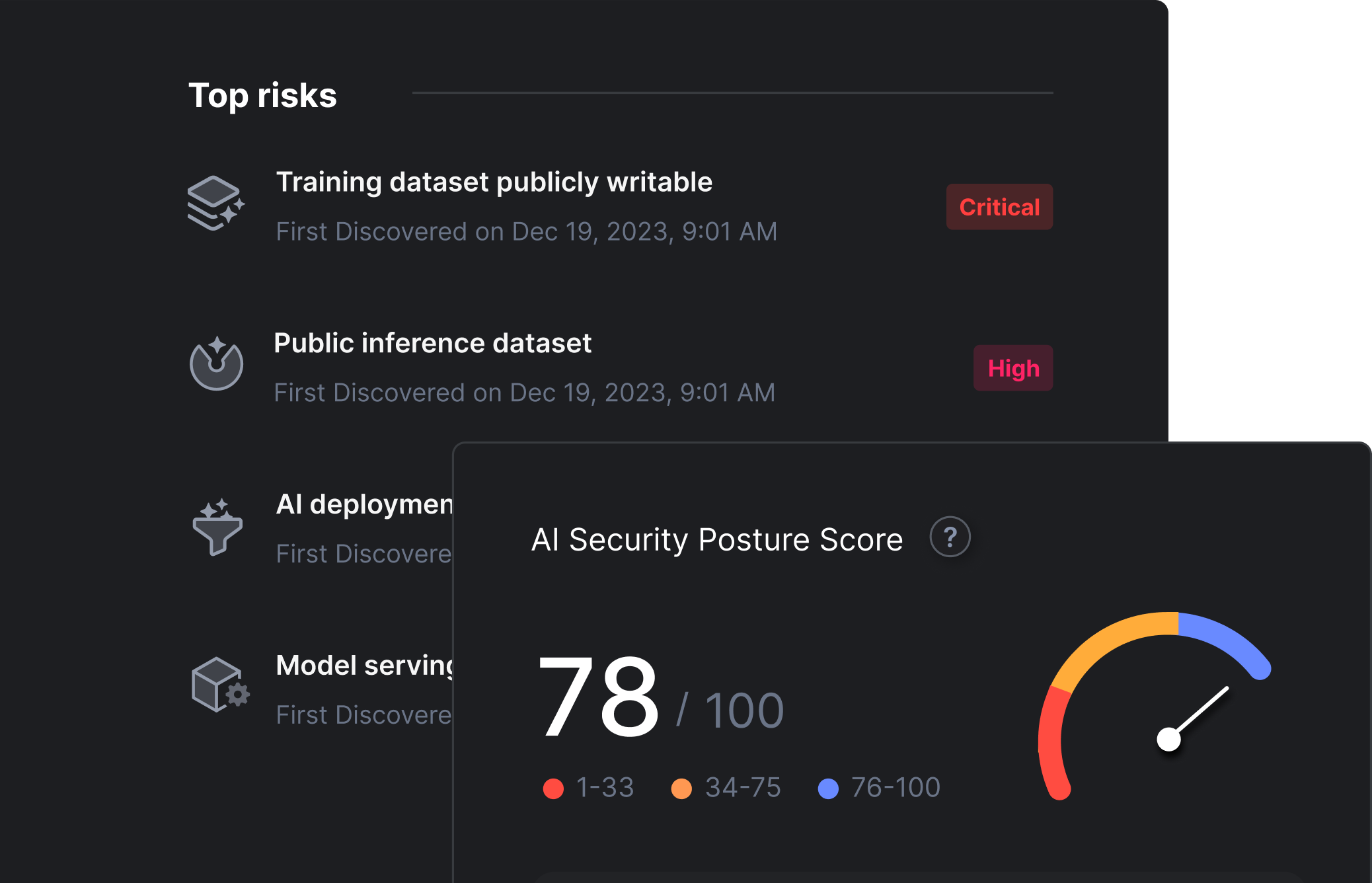

A implementação de novos pipelines e infraestrutura, juntamente com a falta de visibilidade unificada, torna as organizações suscetíveis a novos ataques.

Novos vetores de ataque de IA

A implementação de novos pipelines e infraestrutura, juntamente com a falta de visibilidade unificada, torna as organizações suscetíveis a novos ataques.

Lidando com problemas de expansão de modelos

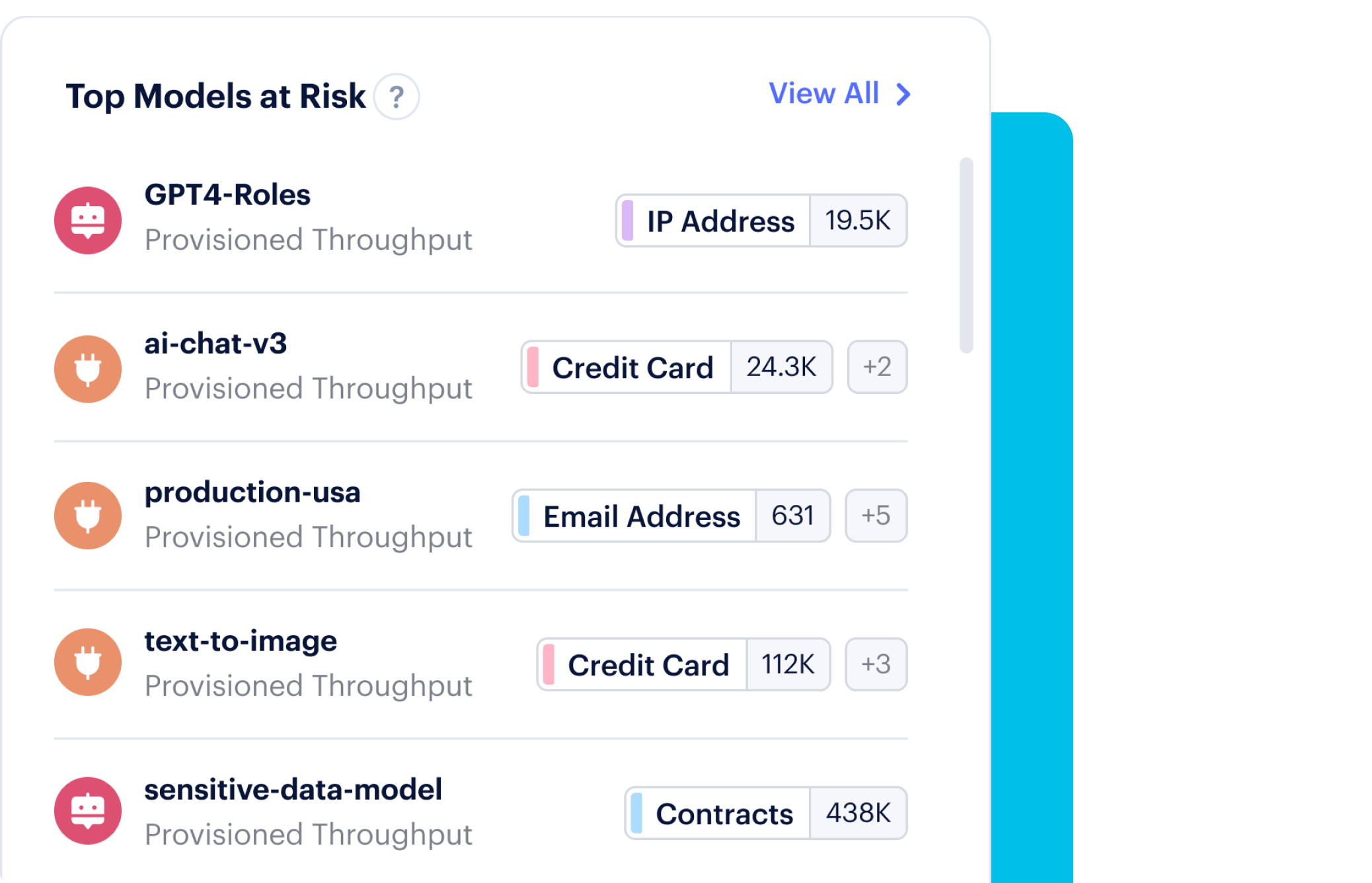

A falta de um inventário de IA pode levar a modelos de IA obscuros, violações de conformidade e exfiltração de dados através de aplicativos alimentados por IA.

Falta de governança

A nova legislação focada em IA exige controles rigorosos sobre o uso de IA e os dados do cliente alimentados em aplicativos alimentados por IA.

Maximize os benefícios transformadores da IA e dos grandes modelos de linguagem (LLMs) sem colocar sua organização em risco. O Gerenciamento de Postura de Segurança de IA (AI-SPM) do Prisma® Cloud oferece visibilidade e controle sobre os três componentes críticos da sua segurança de IA — os dados que você usa para treinamento ou inferência, a integridade dos seus modelos de IA e o acesso aos modelos implantados.

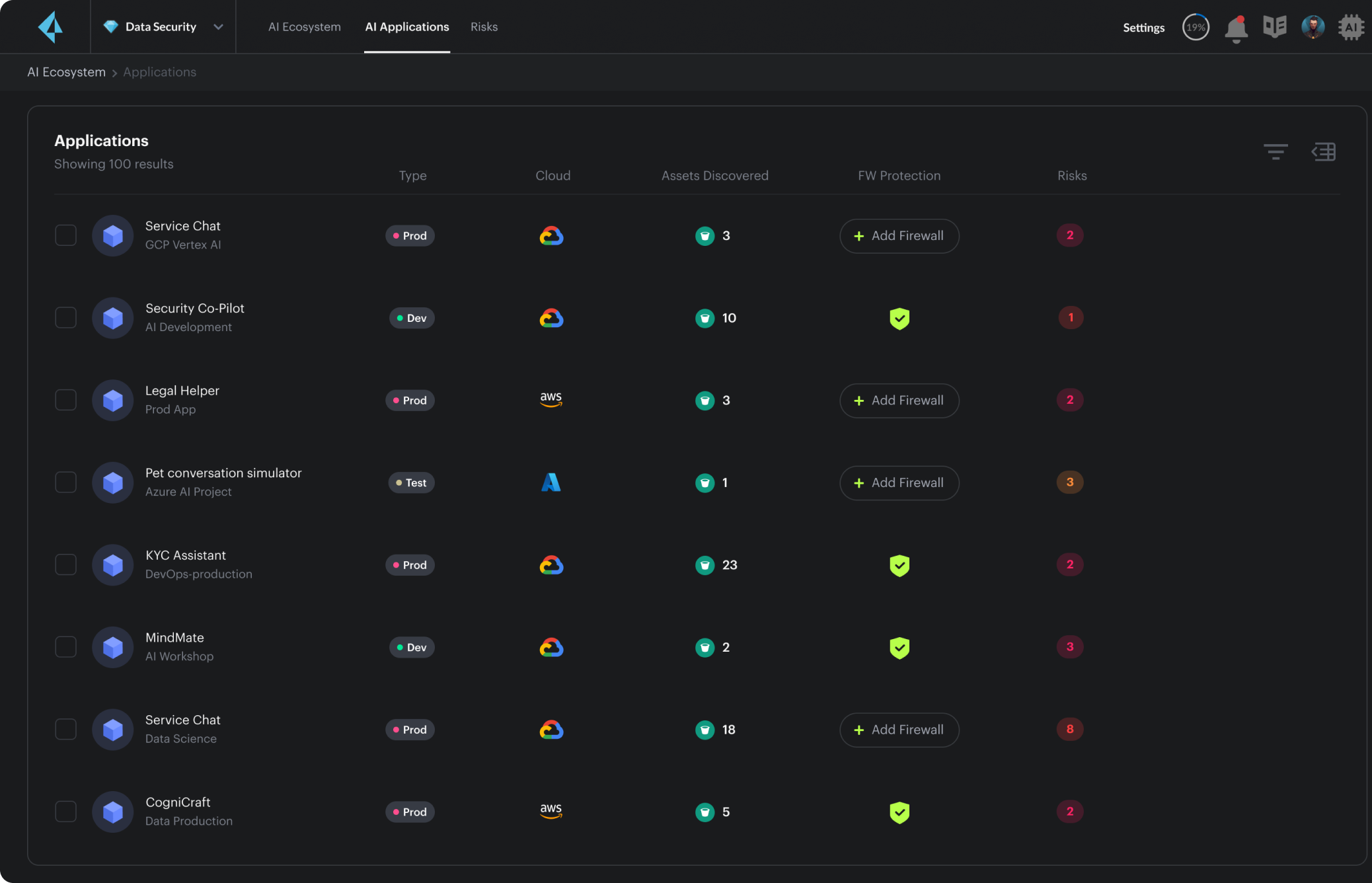

Descubra todos os aplicativos, modelos e recursos associados de IA. Identifique e rastreie a linhagem dos componentes de IA usados nos aplicativos.

Descoberta da pilha de aplicativos de IA

Descubra todos os aplicativos, modelos e recursos associados de IA.

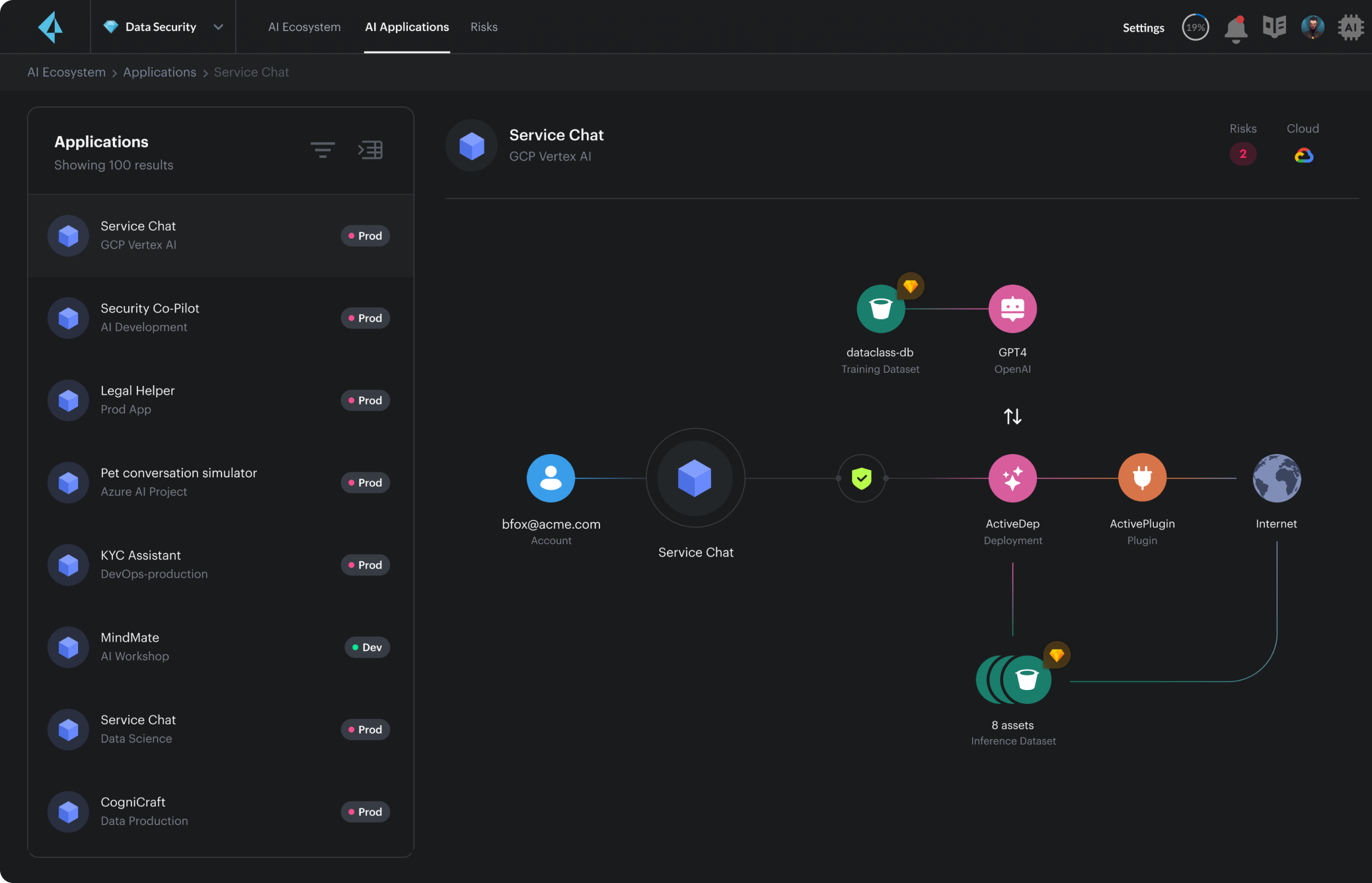

Linhagem de IA

Identifique e rastreie a linhagem dos componentes de IA e das fontes de dados usadas nos aplicativos.

Inventário de modelos

Catalogue os modelos de IA implantados e identifique as atualizações.

Identifique vulnerabilidades na cadeia de suprimentos de IA e encontre modelos configurados incorretamente e recursos de nuvem relacionados que podem levar à manipulação, ao uso indevido e ao roubo.

Evite o comprometimento e o roubo de modelos

Identificando os riscos dos adversários para criar um equivalente funcional.

Encontre configurações incorretas

Reduzindo instâncias e modelos de computação com privilégios excessivos.

Evite o design inseguro de plug-ins

Identificando agentes/cargas de trabalho com privilégios excessivos e vulneráveis.

A manipulação de dados de modelos pode introduzir vulnerabilidades e tendências, expor dados e levar a violações de privacidade de dados e riscos de conformidade e segurança.

Classifique a pilha de IA

Identifique onde estão os dados confidenciais em dados de treinamento e de referência, bibliotecas, APIs e pipelines de dados que alimentam os modelos de IA.

Monitore dados confidenciais

Monitore e controle a exposição de dados, o risco de envenenamento, as violações de privacidade e as violações de segurança.

Priorize as vulnerabilidades

Na infraestrutura que hospeda a IA que está acessando dados confidenciais.